Nvidia は AI 開発者向けに新しい NeMo Guardrails ツールを導入しており、 ChatGPT のような AI チャットボットの狂気を少しでも軽減すると約束しています。このオープンソース ソフトウェアは開発者が現在利用可能であり、AI チャットボットをより便利にし、不安を軽減する 3 つの領域に焦点を当てています。

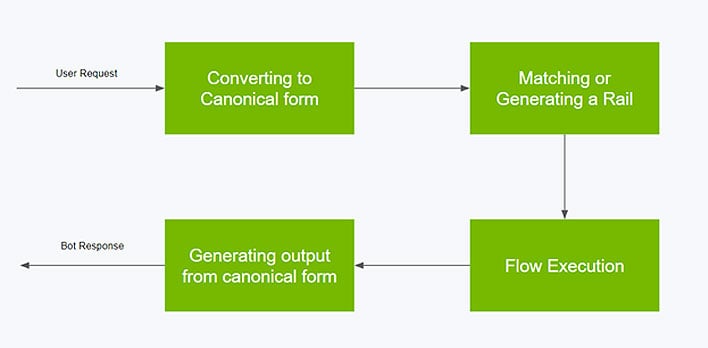

このツールは、ユーザーとユーザーが対話する大規模言語モデル (LLM) の間に位置します。これはチャットボットにとって安全であり、言語モデルに到達する前に応答を傍受して、モデルの応答を停止するか、応答方法に関する具体的な指示を与えます。

Nvidia によれば、NeMo Guardrails は話題、安全、セキュリティの境界に焦点を当てているという。トピックに焦点を当てると、LLM が特定の範囲の応答にとどまるようになるため、最も有用であると思われます。 Nvidia は、同社の人事データベースでトレーニングされたチャットボットを示して、Guardrails をデモしました。 Nvidia の財務について質問すると、NeMo Guardrails でプログラムされた定型的な回答が返されました。

AI チャットボットからいわゆる幻覚が数多く見られるため、これは重要です。たとえば、 Microsoft の Bing Chat は 、最初のデモで いくつかの奇妙で事実に反する応答を提供しました 。 LLM が理解できない質問に直面すると、LLM は多くの場合、質問に答えようとして応答をでっちあげます。 NeMo Guardrails は、こうしたでっちあげの反応を阻止することを目的としています。

安全性とセキュリティの原則は、LLM からの不要な応答をフィルタリングして、ユーザーによる悪用を防ぐことに重点を置いています。すでに見たように、 ChatGPT やその他の AI チャットボットを脱獄 できます。 NeMo ガードレールはこれらのクエリを受け取り、LLM に到達することをブロックします。

NeMo ガードレールは、チャットボットを話題に沿って正確に保つために構築されていますが、万能のソリューションではありません。 Nvidiaは、これが第2の防御線として最も効果的であり、チャットボットを開発および導入する企業は依然として一連の安全策に基づいてモデルをトレーニングする必要があると述べている。

開発者は、アプリケーションに合わせてツールをカスタマイズする必要もあります。これにより、NeoMo Guardrails は、AI チャットボットがユーザーと対話する方法のフレームワークをすでに提供している LangChain など、AI モデルがすでに使用しているミドルウェアの上に位置することができます。

オープンソースであることに加えて、Nvidia は AI Foundations サービス の一部として NeMo Guardrails も提供しています。このパッケージは、独自のモデルをトレーニングおよび保守するための時間やリソースがない企業向けに、いくつかの事前トレーニングされたモデルとフレームワークを提供します。