Nvidia は、本日の で、次世代のエントリーレベル AI およびロボティクスを強化するシステムオンモジュール (SOM) である Jetson Orin Nano の近日リリースを発表しました。

Nvidia によれば、この新バージョンは に比べて 80 倍のパフォーマンス向上を実現します。オリジナル バージョンは 2019 年にリリースされ、特に愛好家や STEM の学生にとって、AI とロボット工学の世界への最低限の入り口として使用されてきました。この新しいバージョンは大幅にパワーアップしているようです。

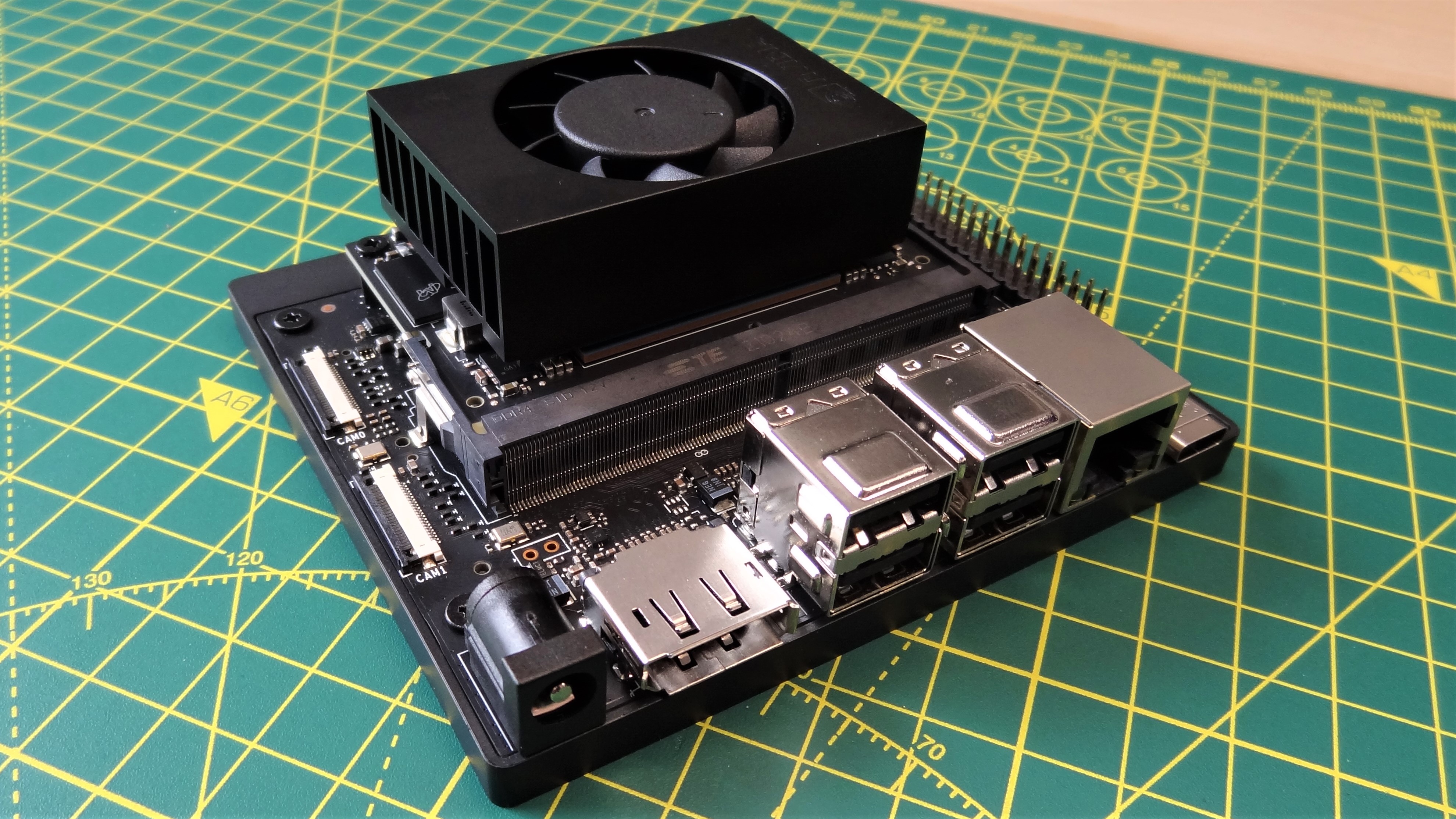

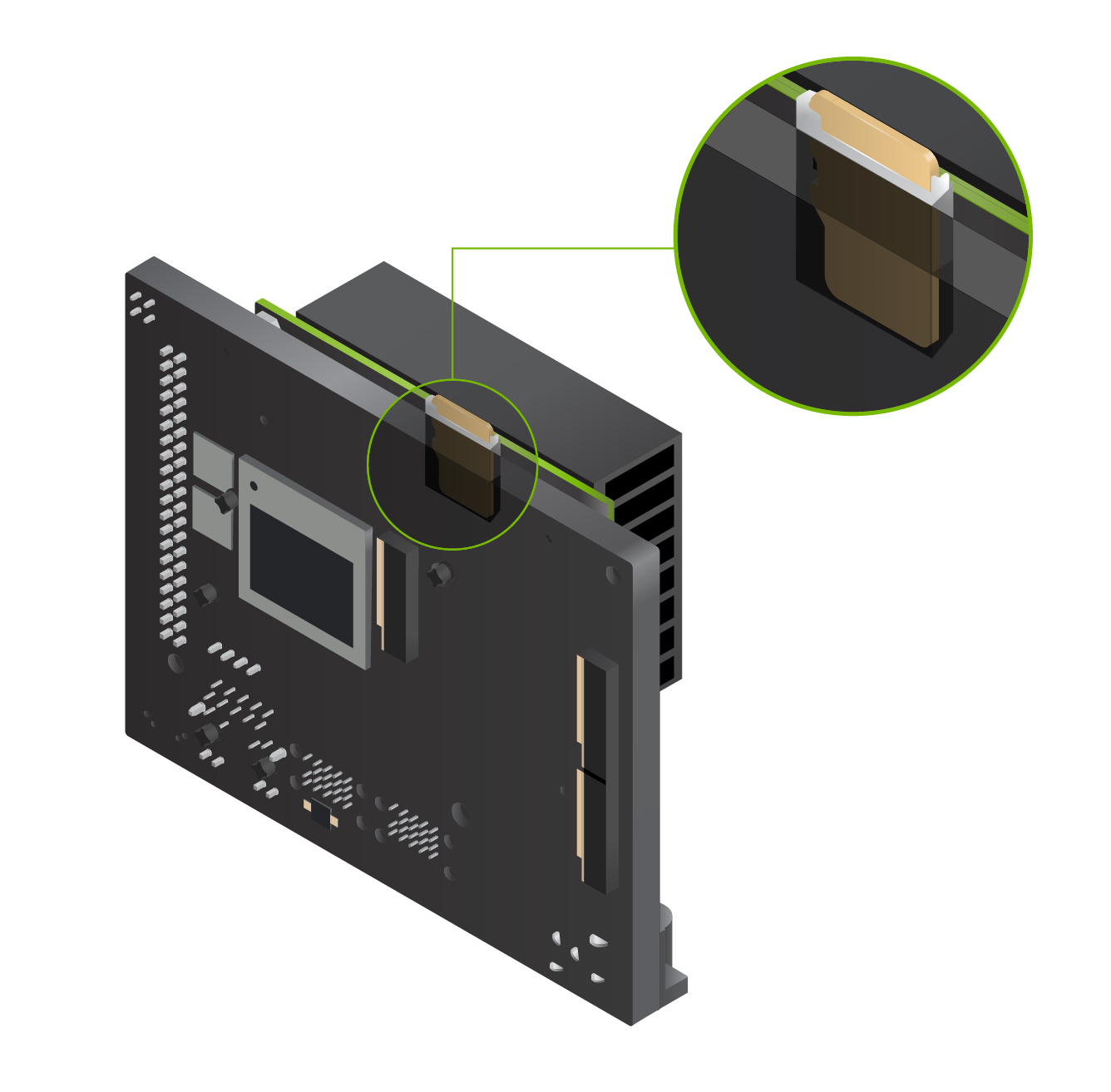

システム オン モジュール (コンピュータ オン モジュールとも呼ばれます) は、マイクロプロセッサを搭載した単一のボードを特徴としています。メモリと入出力 (IO) も備えており、通常はキャリア ボードが付いています。これはシステム オン チップ (SOC) と同じものではありません。SOM はボードベースであり、追加のコンポーネントを含めるスペースがある場合があります。 SOC を含めることもできます。つまり、SOM はすぐに使用できるコンピューティング ソリューションですが、完全なコンピューターではありません。

技術的な話はさておき、Nvidia の最新開発である Jetson Orin について話しましょう。Jetson Orin は、AI およびロボティクス アプリケーションを手頃な価格で処理できるように作られた 6 つの Orin ベースの製品モジュールを搭載して登場しました。その中には、Nvidia Jetson Orin Nanoも含まれます。

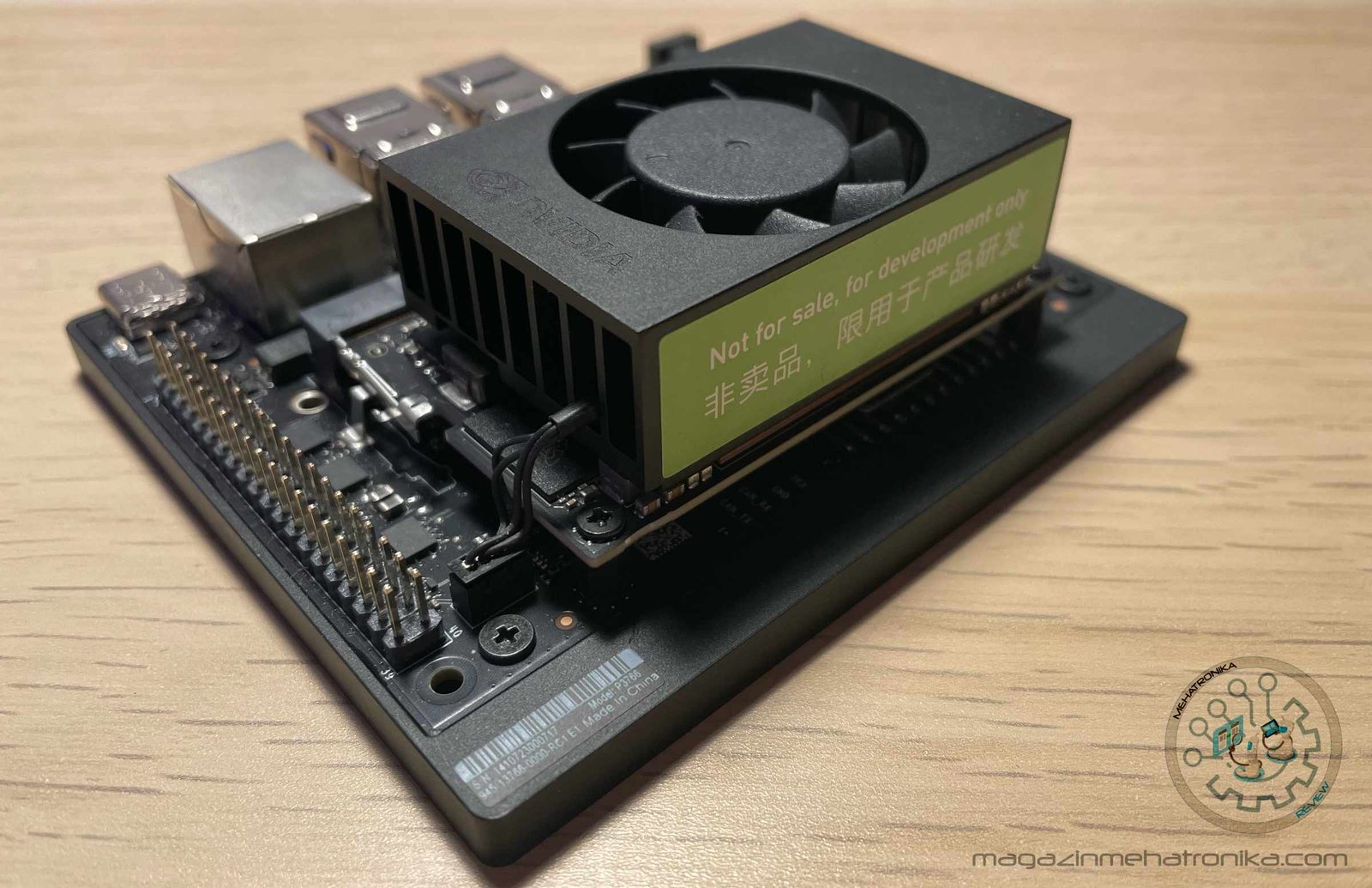

Jetson Orin Nano は、最小のフォーム ファクターの Jetson SOM であるにもかかわらず、最大 40 兆回/秒の演算 (TOPS) の AI 関連タスクを処理できます。 AGX Orin ではパフォーマンスが新たな高みに達し、高度な自律マシンを処理するために 275 TOPS を提供します。

Nvidia の Jetson Orin には、Ampere ベースの GPU、ARM ベースの CPU、およびマルチモーダル センサーのサポートが付属しています。また、Nvidia の Orin NX モジュールと完全な互換性があり、Nvidia の顧客が複数の Jetson モジュールを中心に設計できるようにする完全なエミュレーション サポートも含まれます。その他の特典には、高速入出力を備えた複数の同時 AI アプリケーション パイプラインのサポートが含まれます。

Jetson Orin Nano モジュールには 2 つのバージョンがあり、1 つは 8GB メモリで最大 40 TOPS を搭載し、もう 1 つは 4GB メモリで最大 20 TOPS を搭載します。消費電力の点では、SOM はほとんど何も必要としません。前者は 7 ワットから 15 ワットを必要としますが、後者は 5 ワットから 10 ワットしか必要としません。

Nvidia は、エッジ AI アプリケーションを扱うエンジニアからロボット オペレーティング システム開発者まで、このモジュールが幅広い顧客によって使用されると予測しています。わずか 199 ドルからという低価格により、このテクノロジーはより幅広いユーザーにとって利用しやすくなります。 Nvidia は、Jetson Orin Nano の早期採用企業として、Canon、John Deere、Microsoft Azure などを挙げています。

「今日、何百万人ものエッジ AI および ROS 開発者にとってパフォーマンスが桁違いに向上しているため、Jetson Orin は、想像できるほぼすべての種類のロボット導入にとって理想的なプラットフォームです」と Nvidia 組み込みおよびエッジ コンピューティング部門の副社長である Deepu Talla 氏は述べています。 。

Nvidia は、Jetson Orin は前世代の Jetson SOM と比べてパフォーマンスが 80 倍向上すると主張しています。それはリーズナブルな価格での大幅なステップアップです。このモジュールは 2023 年 1 月から利用可能になります。