マイクロソフトは、2023 年 3 月に人工知能 (AI) の倫理と社会チームを閉鎖した際、多くの批判を浴びました。AI を巻き込んだ スキャンダルがほぼ同時に起きたこと を考えると、これは良い結果とは言えませんでしたが、同社はその意図を明らかにしたばかりです。今後の取り組みに責任を持ち、今後も抑制し続けるためです。

Microsoft の On the Issues ブログ への投稿の中で、レドモンド事務所の責任 AI 最高責任者である Natasha Crampton 氏は、倫理チームが解散された理由について次のように説明しました。 」

代わりに、Microsoft はプライバシー、セキュリティ、アクセシビリティ チームと行ってきたアプローチを採用し、「責任ある AI を全社に埋め込みました」。これは実際には、Microsoft が「各中核ビジネス グループ内で責任ある AI の先頭に立って任務を負う」上級スタッフを配置し、さらに「より定期的かつ直接的に関与するためのさまざまなスキルと役割を備えた責任ある AI の「チャンピオン」の大規模なネットワーク」を配置していることを意味します。

さらにクランプトン氏は、マイクロソフトには「責任ある AI に 350 人近くの人員が取り組んでおり、そのうちの 3 分の 1 強 (正確には 129 人) がフルタイムで専任している」と述べました。残りの従業員は、仕事の中核として責任ある AI の責任を負っています。」

Microsoftが倫理と社会チームを閉鎖した後、クランプトン氏は、一部のチームメンバーがその後全社のチームに組み込まれたと指摘した。しかし、2023年初めに1万人の従業員を解雇したマイクロソフトの大規模な人員削減の一環として、グループのメンバー7人が解雇された。

スキャンダルを乗り越える

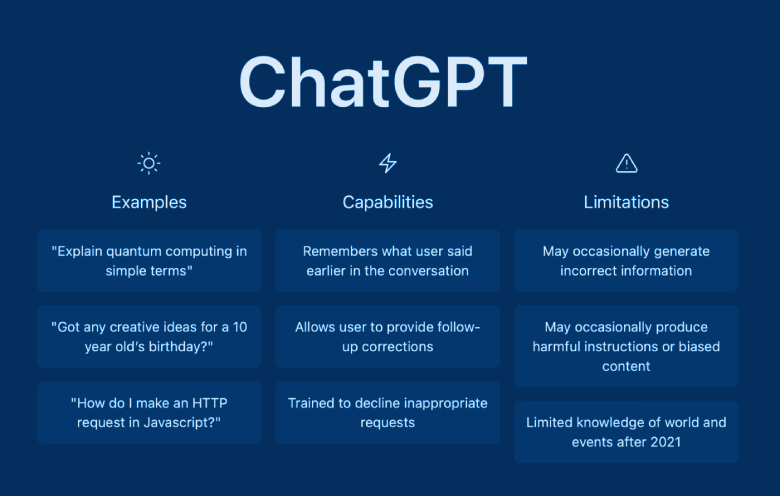

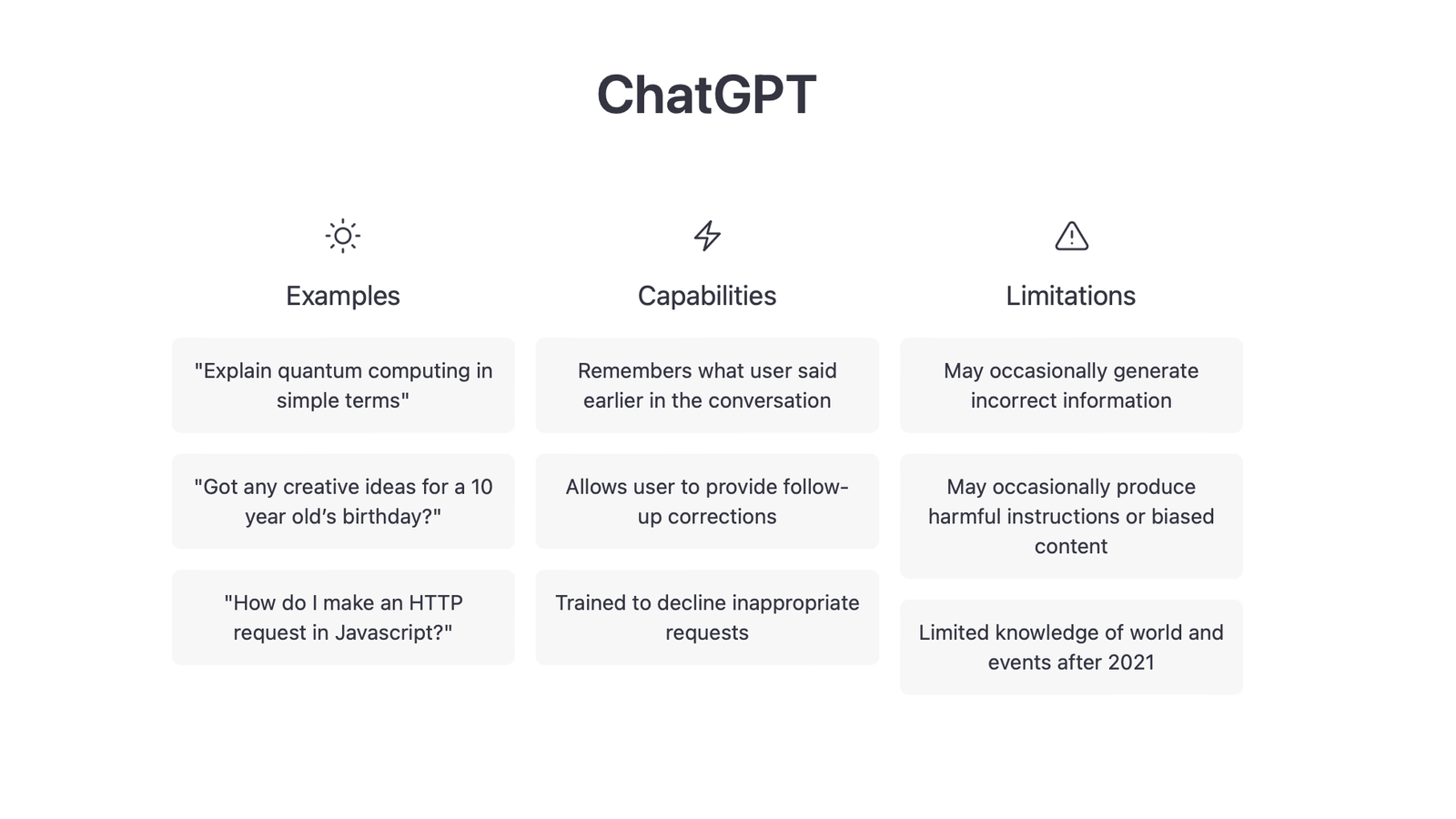

ここ数カ月間、AIに はスキャンダルがほとんどなく 、MicrosoftによるAI倫理チームの解散に対する反発を煽ったのはこうした懸念だった。もしマイクロソフトが自社の AI 製品を責任ある方向に導くための専門チームを欠いていたとしたら、同社の Bing チャットボットで悪名が高い種類の不正行為や問題のある行為を抑制するのは困難になるだろう、と考えられていました。

同社の最新のブログ投稿は、間違いなく一般の人々のこうした懸念を軽減することを目的としている。 MicrosoftはAIへの取り組みを完全に放棄するのではなく、全社のチームが責任あるAIの専門家と定期的に連絡を取ることを確保しようとしているようだ。

それでも、AI倫理と社会チームの閉鎖がうまくいかなかったのは疑いの余地がなく、Microsoftにはこの問題に対する一般大衆の意識を和らげるためにまだ道が残っている可能性がある。実際、Microsoft 自体でさえ、ChatGPT (その開発者である OpenAI は Microsoft が所有している) は規制されるべきだと 考えています。

つい昨日、「AIのゴッドファーザー」と呼ばれるジェフリー・ヒントン氏がGoogleを辞め、AIの拡大のペースと方向性について 深刻な不安を 抱いているとニューヨーク・タイムズに語った一方、最近、主要な技術専門家のグループがAIの一時 停止を 求める公開書簡に署名した。 AI のリスクをより深く理解できるように AI を開発する 。

Microsoft は倫理的な AI 開発に関する懸念を無視しているわけではないかもしれませんが、その新しいアプローチが正しいものであるかどうかはまだわかりません。 Bing Chat が物議を醸したスタートを経て、ナターシャ・クランプトンと彼女の同僚たちは、事態が良い方向に変わることを期待しているだろう。