Apple は毎年、 iPhone が 素晴らしいカメラ システムを備えていると宣伝します。そして、確かにハードウェアは確かに印象的です。 iPhone 14 Pro には、ピクセルビニング技術(1つの大きなピクセルを構成する4つのサブピクセル)を備えた48MPメインカメラへの大幅なジャンプ、光学3倍の望遠レンズなど、カメラのアップグレードに関してAppleが提供する最新の進歩が含まれています。ズーム、高速ナイトモードなど。繰り返しになりますが、ハードウェアの面では、iPhone 14 Proのカメラは印象的です。そして、そうです!

しかし、ソフトウェアが撮影した画像を台無しにし続けたら、優れたカメラ ハードウェアが何の役に立つでしょうか? iPhone 13 の ラインナップ以来、ProRaw 形式で撮影しない限り、iPhone から撮影した画像は、古い iPhone や競合する 最高の Android スマートフォン で撮影した画像と比較すると、見た目が悪くなるだけのようです。それは、Apple がコンピュテーショナル フォト グラフィー と、写真を撮影するたびの後処理のレベルを大幅に上げてきたためです。これは私のイメージを台無しにするので、Apple は精神安定剤を飲んでレベルを下げる必要がある。

これらの「スマート」機能は、謳われているほどスマートではありません

写真を撮るには、光と細部を捉えて画像を作成するのに役立つセンサーが必要です。ただし、スマートフォンは完全な よりもはるかにコンパクトであるため、センサーでできることはかなり限られています。そのため、Apple や他のスマートフォン メーカーは、スマートフォンでキャプチャした写真の画質を向上させるためにソフトウェアに依存する可能性があります。

Apple は 2018 年に iPhone に Smart HDR を導入し、このソフトウェア機能は iPhone 14 ラインナップで 4 回目になります。 Smart HDR 4 を使用すると、デバイスはさまざまな設定で複数の写真を撮影し、各画像の「最良の」要素を 1 枚の写真に結合します。このプロセスでは多くのコンピュテーショナル フォトグラフィーが行われており、その目的は画像の見栄えを良くすることですが、実際にはその逆になります。

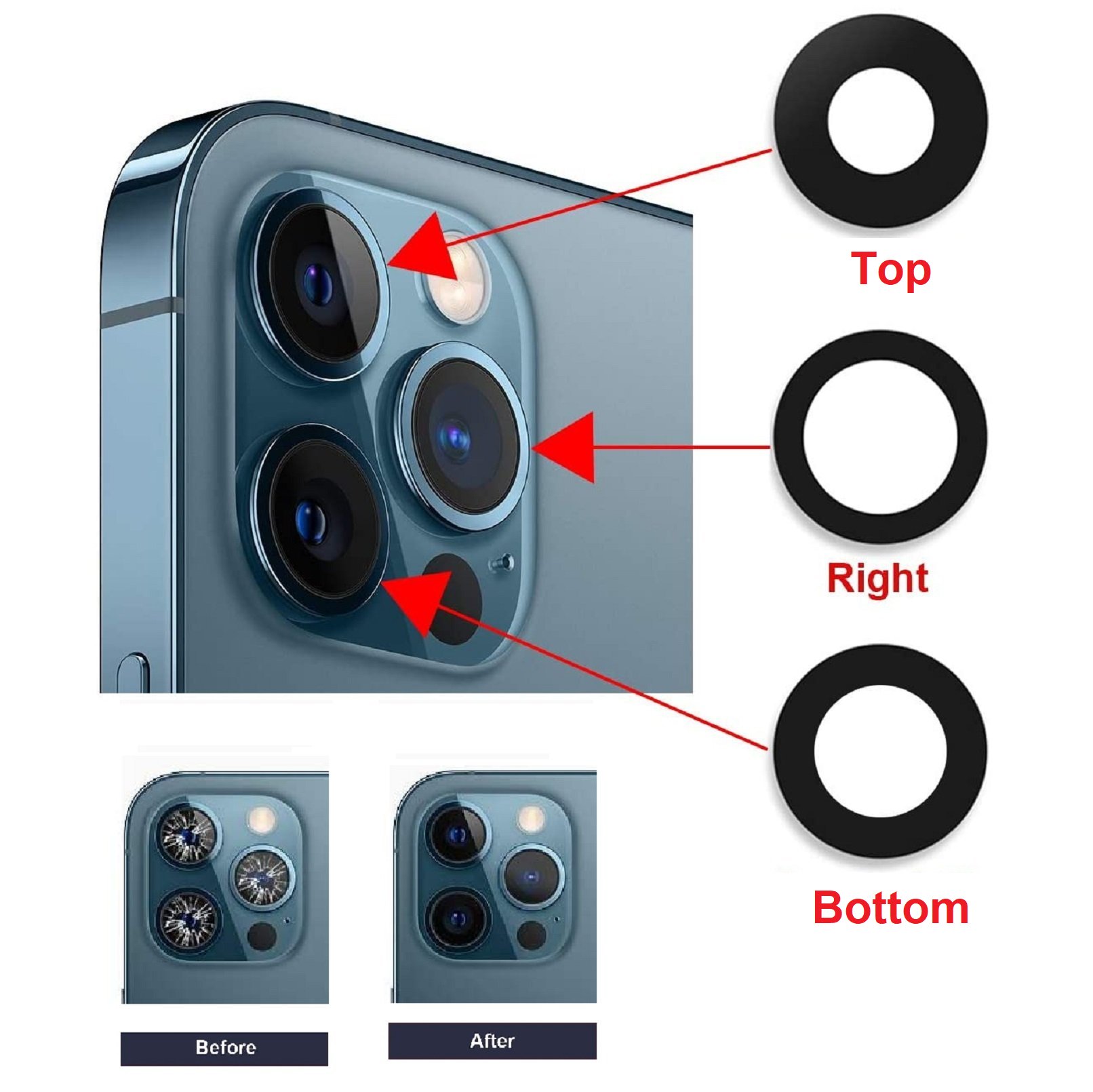

/article-new/2022/09/iphone-14-pro-rear-cameras.jpg)

iPhone 14 (または iPhone 13) で写真を撮り、すぐに隅にあるサムネイルをタップして、撮ったばかりの画像を表示したときにこのことに気づいたかもしれません。画像は一瞬撮影したものと同じように見えますが、その後は鮮明になりすぎて、色がより人工的に見えたり、特定の領域が色褪せたり、他の領域が過度に飽和したりすることがあります。肌の色でさえ、実際の生活とは少し異なって見える場合があります。 シリーズで初めてナイト モードが登場したとき、私はナイト モードが大好きでしたが、現在の競合他社と比べて、ナイト モードでは過度の処理により写真が「明るく」見えすぎ、夜の写真の多くは、撮影したように見えません。夜。

暗い場所でセルフィーを撮ろうとしたことはありますか?確かに、iPhone には前面カメラ用のナイトモードもありますが、あまり役立つとは思えませんでした。 iOS は画像を「保存」するために画像に多くのデジタル アーティファクトを追加するため、低光量の自撮り写真は何をしてもひどいものに見えます。しかし、写真を保存すると、悪くて汚い水彩画のように見えてしまいます。実際、薄暗い環境では iPhone 14 Pro で自撮り写真を撮らないようにしています。ほとんどの場合、見た目が悪くなってしまうからです。

iPhone で撮影した写真がいつからこのようになったのかはわかりませんが、iPhone 13 シリーズから顕著になったような気がします。間違っている可能性もありますが、 の画像がこれほど誇張されていたことは特に覚えていませんし、iPhone 11 Pro の写真も特に覚えていません。 iPhone は以前はリアルで自然に見える写真を撮影していましたが、スマート HDR とコンピューテーショナル フォトの後処理がすべて手に負えなくなり、画像の見栄えが本来より悪くなってしまいました。

Apple、この機能をオフにしましょう

数年前までは、Smart HDR をまったく使用しないことも可能でした。これはオプションの設定であり、必要に応じてオンまたはオフを切り替えることができます。この設定は、iPhone XS、iPhone XR、iPhone 11 シリーズ、 iPhone SE 2 、および iPhone 12 モデルでのみ利用可能でした。 iPhone 13 以降、Smart HDR を有効にするオプションは削除されました。

このオプションを廃止したのは近視眼的な行動であり、Apple がある時点でこのオプションを復活させることを願っています。私の iPhone 14 Pro は、特に写真撮影に使用する個人用の主要なデバイスであるにもかかわらず、他の人と共有するのに適しているかどうかを判断する前に、画像を編集する必要がある場合があります。 Apple が Smart HDR でやろうとしていることは理解できますが、結果として得られる画像は通常、実際に見られるものと比較するとあまりにも人工的に見えます。

たとえば、晴れた環境で屋外で写真を撮ると、写真に青い空が飽和しすぎて偽物のように見えることがあります。また、色の変更によって肌の色が少し悪く見えることもあると思います。これについては 、YouTuber の Marques Brownlee (MKBHD) も最近のビデオで話しています 。

Android の競争はより良いものになる

繰り返しになりますが、Apple は iPhone 14 Pro のラインナップにいくつかの優れたカメラハードウェアを投入しましたが、ソフトウェアの過剰処理によって汚されています。私は Digital Trends でここにいる間、いくつかの異なる Android デバイスを手に取ってきましたが、競合する一部の Android フォンが iPhone 上で写真をどのように処理するかを楽しむようになりました。

たとえば、 Google Pixel 7 は 、特別な努力を必要とせずにメインカメラで素晴らしい写真を撮影します。カメラを向けて撮影するだけで、目で見たとおりの結果が得られます。 Googleは今でも独自の画像処理を多用しているが、Appleのように写真を不自然に見せることはない。私が気づいた限り、唯一の問題はセルフィーです。肌のトーンを正確に捉えることはできませんが、それを除けばメインカメラは素晴らしいです。色はバランスが取れており、色褪せておらず、ソフトウェアは「見栄え」を良くしようとあまり努力しません。なぜなら、すでにそうなっているからです。また、 Magic Eraser のような楽しいツールを使用して、ショットの編集には Google Pixel 7 を使用することを好みます。

また、これらの写真の比較のために古い もテストしました。肌のトーンや色をあまりうまく処理できないとは思いますが、暗い場所での自撮り写真ではうまく機能するようで、これには驚きました。ナイトモードの写真も非常にうまく処理され、iPhone 14 Proのように色が飛んでしまうのではなく、自然でリアルに見えます。

つまり、Apple は「最高の」カメラ ハードウェアを持っていると言える一方で、 iOS とコンピュテーショナル フォトグラフィーへの過度の依存が画像の見え方を台無しにしているのです。もちろん、この美学を好む人もいるかもしれませんが、私は個人的に、自分の写真の多くがいかに不自然に見えるかに我慢できません。 Apple は Smart HDR 機能をトーンダウンするか、少なくとも希望に応じてオフにするオプションを復活させる必要があります。なぜなら、今は状況があまり良くないからです。